视启未来蒋博受邀参加广东省人工智能大会,空间智能大脑 SpatialPoint 首度亮相

4 月 27 日,广东省人工智能应用对接大会在深圳成功举办,聚焦人工智能技术与产业落地深度融合。AI 初创企业视启未来受邀参会,重磅展示与清华大学、IDEA 研究院联合研发的 SpatialPoint 空间智能大脑。视启未来蒋博现场带来主题技术分享,并表示 SpatialPoint 是公司构建世界模型、推动 AI 从数字世界走向物理世界核心愿景的关键布局。

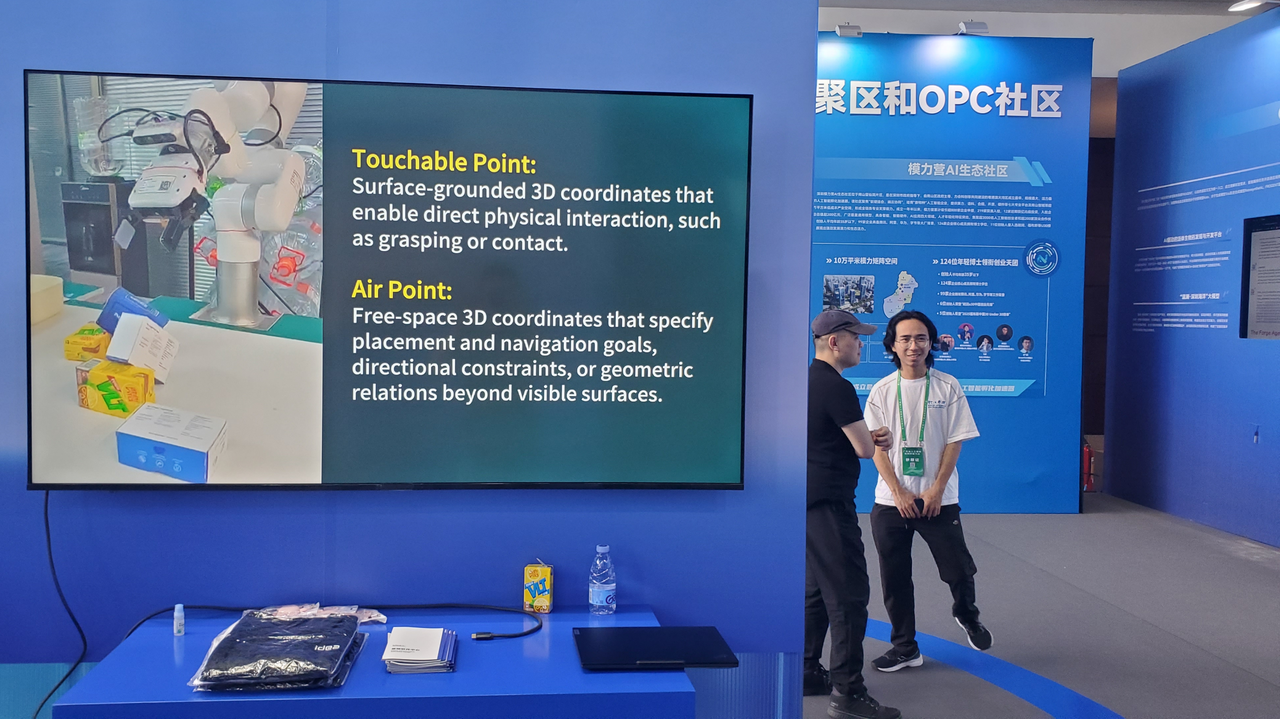

现场展示:一个模型,搞定抓取、放置、导航全场景

在大会展示区,视启未来通过视频演示,直观呈现 SpatialPoint 的空间交互能力。依托 RGB‑D 深度信息原生融合技术,模型可根据语言指令精准输出 3D 空间坐标,单模型精准完成机械臂抓取、指定位置放置、移动机器人自主导航等操作。

图1 SpatialPoint 现场展区

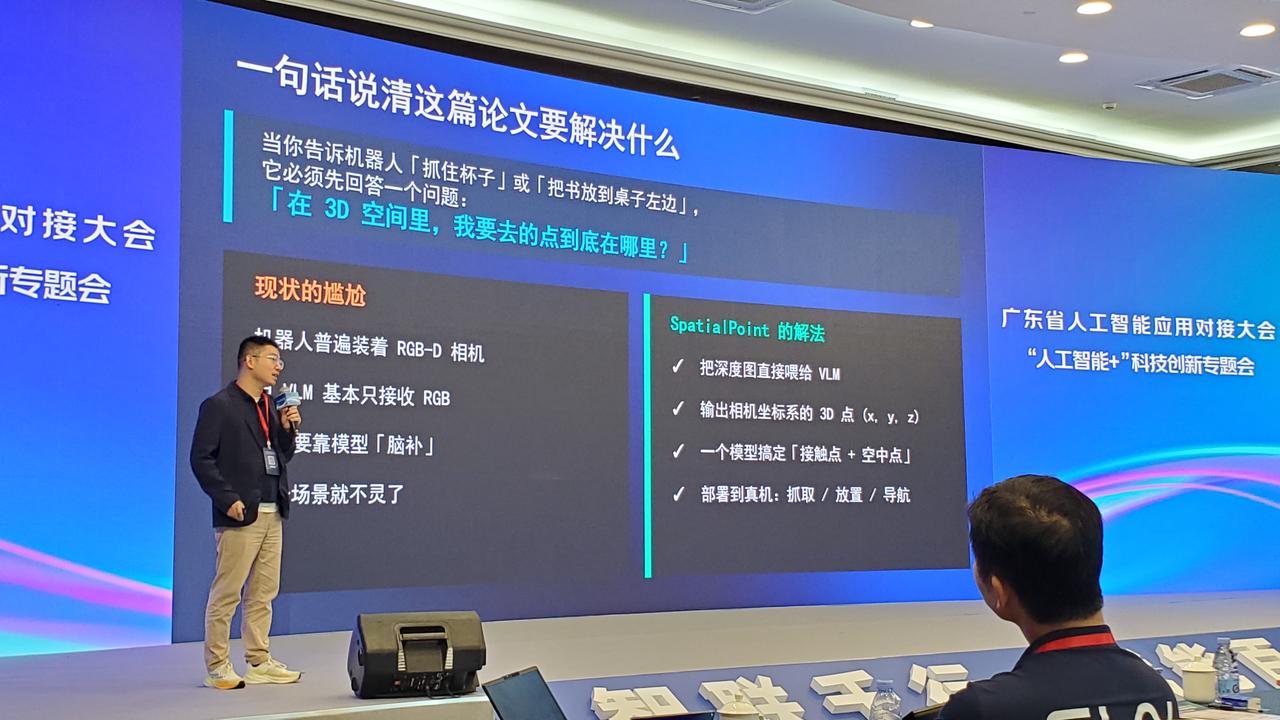

技术突破:深度信息原生融入,破解行业落地难题

蒋博在演讲中介绍,传统 VML 大多仅依赖 RGB 视觉输入,几何空间信息需要模型 “脑补”,容易出现定位不准、场景泛化弱、多模块拼接误差大等痛点。

图2 传统 VLM 与 SptialPoint 的对比

SpatialPoint 创新将深度信息作为与 RGB**、文本并行的核心输入**,搭配自研260 万组 RGB‑D 问答数据集,统一支持物体表面实点(抓取 / 按压)与空间虚点(放置 / 导航)预测,无需额外微调即可覆盖主流机器人操作任务。

图3 SpatialPoint 创新性地提出实点和虚点概念

性能领跑:商用级精度,满足产业落地需求

实测数据显示,SpatialPoint 在关键指标上全面优于主流模型,更贴合工业与商用场景的稳定性要求:

(1)实点预测:有效操作位置准确率 79%,距离误差仅 17.2 毫米,精度较传统模型提升超 30 倍

(2)虚点推理:训练 1 轮方向准确率达 48.86%,远高于同类方案

(3)复杂空间定位:方向准确率突破 43%,可稳定适配多样化场景

蒋博表示,与多数停留在实验室的技术不同,SpatialPoint 已完成真实机器人部署验证。视启未来将以 SpatialPoint 为重要节点,持续推进“空间感知 — 具身交互 — 世界模型”的技术落地闭环,推动人工智能从数字世界走向开放、动态的物理世界,为机器人、智能制造等领域提供更可靠的能力支撑。

视频1 一个模型实现导航、抓取和放置